El Pentágono soltó la bomba hace unas horas. Anthropic tiene hasta este viernes a las 17:01 para aceptar que sus modelos de IA se usen para lo que el Pentágono considere oportuno. Es algo que está poniendo patas arriba la conversación sobre el uso ético de la IA, pero más importante que eso, pone sobre la mesa una intención muy clara por parte de Estados Unidos: la de que si consideran que hay que usar todos los recursos en cuestión de defensa nacional, todos los recursos pertenecen al Estado.

Y ahí entra la inteligencia artificial de empresas privadas.

En corto. Dario Amodei es el CEO de Anthropic. Puede que te suene más el nombre de Claude, uno de sus modelos. Éstos son muy versátiles, pero tienen una línea roja muy clara: no pueden usarse para vigilancia masiva de ciudadanos estadounidenses (ojo con el matiz). Tampoco para el desarrollo de armas o el uso de armamento autónomo controlado totalmente por IA. Y esto es algo que choca con lo que quiere el Pentágono: usar sin restricciones los modelos de Anthropic.

¿Por qué los de Anthropic, te preguntarás? Pues porque esta empresa ofreció su herramienta al Gobierno por el precio simbólico de un dólar, lo que les valió un contrato de 200.000.000 dólares. No les salió mal la jugada, y poco a poco sus modelos se fueron integrando con los de Palantir. Ahora, EEUU quiere disponer de una IA ‘desatada’, pero como explica mi compañero Javier Lacort, las leyes y ética de las FFAA de Estados Unidos se cimentan sobre que un soldado puede y debe desobedecer una orden manifiestamente ilegal.

Una IA puede hacer lo que quieran que haga.

Una palanca de 1950. Un contrato de 200 millones de dólares es jugoso, pero viendo las barrabasada que se invierten en IA continuamente, es calderilla. Anthropic lo tendría tan fácil como negarse y despejar el terreno para que otro ocupe su lugar en el Pentágono, ¿verdad? Pues… no es tan sencillo. Y no lo es por dos motivos.

El primero es que ya está muy integrada en todos los sistemas, procesos y servicios que el Departamento de Defensa utiliza de forma cotidiana. Es un barco demasiado grande como para que cambie el rumbo. «Conoce» demasiado de los interiores de esos sistemas que deben ser altamente secretos. Pero lo más importante es que Estados Unidos tiene una palanca para adueñarse de lo que se le antoje. Lo único que debe argumentar es que sea por una necesidad de seguridad nacional.

En 1950, durante la Guerra de Corea, nació la Defense Production Act, una ley que otorga al presidente poderes para asegurar suministros necesarios para la defensa nacional. Esto, por ejemplo, da poder al Gobierno para exigir a las empresas que prioricen contratos con el Estado para asignar materiales, servicios e instalaciones. También permitir ayudas para ampliar la capacidad productiva y, en definitiva, poner a las mayores empresas del país a funcionar en función de lo que se necesite.

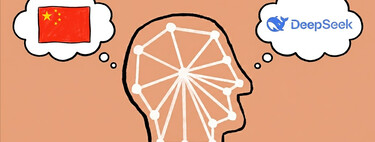

Demasiado poderosa para ser privada. Este documento se ha ido expandiendo y ampliando con el tiempo, pues las necesidades de 1950 no son las mismas que las de décadas posteriores, y en 2023 se firmó la Orden Ejecutiva 14.110. Es una que obliga a los propietarios de los modelos de IA más potentes a notificar al Gobierno cuando entrenen sistemas que puedan suponer un riesgo para la seguridad nacional, la economía o la salud pública. Tras él, se han ido firmando otros borradores ampliando las exigencias sobre la IA, pero lo cierto es que el Pentágono no necesita publicar nada nuevo para presionar a Anthropic.

Según el Título I (el de ordenar que ciertos productos o servicios se suministren al Gobierno), el Pentágono podría hacerse con la IA de Anthropic para que cumpla sus designios. El respaldo es el que ya hemos comentado: esa “defensa nacional”. Y, en la práctica, se define que, si la empresa no quiere que su IA haga ciertas cosas por esa especie de código moral, si pasa a ser propiedad del Pentágono, se puede eliminar la barrera ética.

Castigo disciplinario a la “IA woke”. Y, ahora, la gran pregunta. ¿Puede Anthropic decir algo como “mira, te quedas los 200 millones y cada uno por su lado”? Pues… no. O no de una forma tan sencilla. Ya he comentado que Claude está demasiado dentro de los sistemas del Pentágono (hasta el punto de que fue utilizado en la operación para capturar a Nicolás Maduro) y “sabe” demasiado. Está muy integrada en los sistemas clasificados del Pentágono, y como podemos adivinar, no la iban a dejar ir tan fácilmente.

Y ahí entra la figura de Pete Hegseth. Es el Secretario de Defensa, y ha calificado esa vara moral de Anthropic como la de una “IA woke”. Sí… Porque Google, OpenAI y xAI permiten que el Gobierno use sus modelos en cualquier escenario “legal” (para el Gobierno, claro), pero no Anthropic, y además de la palanca de la Defense Production Act, Estados Unidos puede castigar duramente a la empresa.

Si no se “rinden” a sus peticiones, podrían identificar Anthropic como una empresa que ponga en riesgo la cadena de suministro del país. Sería como el veto a Huawei de hace unos años, pero a una empresa nacional. En la práctica, las empresas de EEUU no podrían trabajar con Anthropic. Es decir, el país tiene un par de buenos “argumentos” para que Anthropic entregue esa vara moral.

Aprendizaje. No falta tanto para las 17:01 del viernes 27 de febrero, momento en el que sabremos si Anthropic accede por las buenas o por las malas a las “peticiones” del Pentágono. Lo que queda claro es que esto es una lección. No tanto para las empresas estadounidenses que, al final, operan bajo ese paraguas de la Defense Production Act, sino de las del resto del mundo. Concretamente, de las europeas. Y estoy pensando en la carrera espacial.

Europa, al igual que China, Rusia y la propia Estados Unidos, se ha embarcado en la nueva carrera espacial. Van a otro ritmo porque, hasta no hace tanto, tenían a Estados Unidos como ese socio y aliado que siempre estaría ahí. Los aranceles y la guerra de Ucrania, entre otras cosas, han quebrado esa confianza y Europa se ha dado cuenta de que tiene que ponerse las pilas en muchos frentes.

Y una de ellas es en quién confía. Por ejemplo, SpaceX se ha convertido en un socio en comunicación satelital y envíos al espacio, pero SpaceX ya no es sólo una empresa de cohetes: es una empresa que posee xAI. Y, como comenté, xAI tiene vínculos con el Departamento de Defensa de EEUU. Pero además SpaceX es X -Twitter-, una base de datos tremenda de ciudadanos europeos. Y ahí está la otra lectura: países extranjeros no pueden depender en sistemas críticos de proveedores que operen bajo el paraguas estadounidense… y la Defense Production Act.

–

La noticia

EEUU tiene un mensaje para las empresas de IA: en caso de necesidad, esa IA es del Estado

fue publicada originalmente en

Xataka

por

Alejandro Alcolea

.